英伟达真的危险了!三大潜在对手的“大杀器”太强

科技领域日新月异,没有谁能够永远保持冠军的位置,而在人工智能介入之后,未来变得更加难以预测。

对于英伟达来说也是如此。

人工智能(AI)市场蓬勃发展,整个市场规模预计将从去年的2350亿美元增长到2028年的6310亿美元。自2023年初以来,顶尖的AI股票已经获得了丰厚的回报,未来前景一片光明。

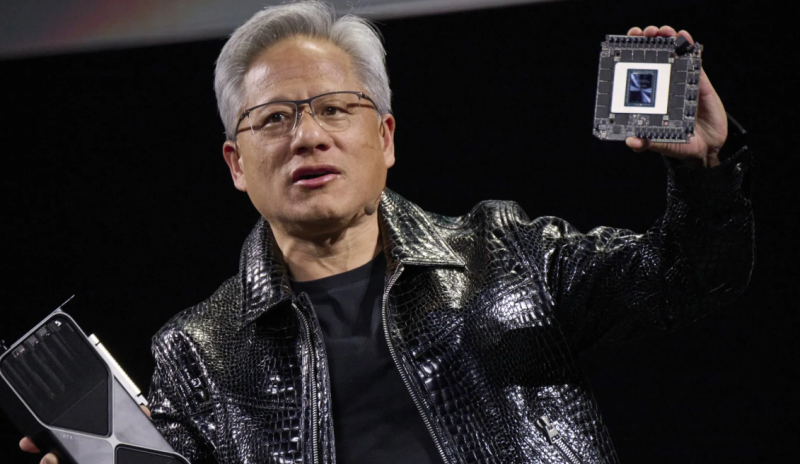

英伟达无疑是迄今为止人工智能领域最明显的赢家。其GPU芯片已成为人工智能超大规模企业训练和运行人工智能模型的实际选择,它仅在过去四个季度就创造了1870亿美元的收入。

但其中大部分资金都来自少数几家超大规模数据中心运营商。随着这些数据中心项目的支出不断增加,超大规模数据中心运营商面临着越来越大的削减成本的压力。

对于数据中心运营商来说,为了降低成本,最为立杆见影的做法就是开发和制造自有的AI芯片,用来替代高价的英伟达芯片。这对英伟达肯定不是什么好消息。

讽刺的是,目前最具竞争力的三家有潜力开发自有芯片的公司,恰恰是英伟达的大客户。它们可能会成为最大的英伟达“杀手”。

1. Alphabet

在最近发布Gemini 3人工智能模型后,Alphabet可能对英伟达在人工智能领域的统治地位构成最严重的威胁。大多数评论都认为Gemini 3是人工智能模型发展历程中令人瞩目的进步。但Gemini 3最引人注目之处或许在于,Alphabet显然是使用其自主研发的人工智能芯片而非英伟达的GPU对其进行训练的。

英伟达的GPU利用其CUDA编程技术,高效地发挥GPU强大的计算能力来处理人工智能任务。然而,Alphabet的张量处理单元(Tensor Processing Unit,TPU)是专用集成电路(Application Specific Integrated Circuit,ASIC),这意味着它们的设计和制造仅针对特定任务,也就是Alphabet的人工智能。

Alphabet利用其TPU成功训练Gemini 3表明,英伟达的GPU并非不可替代。这并不意味着其他公司会轻易效仿Alphabet的做法,但这确实传递了一个信息:这种可能性是存在的。随着时间的推移,其他超大规模数据中心运营商可能会设计自己的AI ASIC,从而蚕食英伟达的业务。

不过,至少在目前来看,英伟达相对于Alphabet的优势地位仍然存在,原因如下:

简而言之,GPU功能全面、用途广泛,而TPU则专为特定任务而设计,性能强大。TPU可以极快地运行某些机器学习模型,但英伟达拥有多年的开发者忠诚度和成熟的工具。Alphabet要想缩小差距,就必须让其TPU更易于采用,并得到更好的软件框架支持。

2. 亚马逊

亚马逊运营着全球领先的云计算服务平台AWS。人工智能为AWS带来了强劲的发展势头,因为它主要运行在云端,就像大多数现代软件一样。亚马逊持续建设数据中心以提升其云容量,而这些数据中心需要大量的芯片。

此前,亚马逊自主研发了人工智能芯片Trainium,并开始加大投入。该公司与人工智能应用Claude的开发商Anthropic建立了合作关系。两家公司近期宣布启动“雷尼尔计划”(Project Rainier),这是一个庞大的人工智能芯片集群。该计划目前使用了近50万个Trainium2芯片,预计到今年年底将扩展到100万个以上。

当然,这并不一定会导致英伟达立即退出市场,但确实削弱了英伟达对市场的垄断地位。至少,过去一年毛利率高达70%的英伟达可能会开始感受到一些压力。亚马逊自身对芯片的需求,以及像Anthropic这样知名人工智能开发商的需求,都可能进一步加大对Trainium的投入,这对英伟达的增长构成潜在的又一阻力。

不过,亚马逊的人工智能芯片与英伟达的GPU相比,仍然存在“兼容性”问题。11月初,人工智能初创公司Cohere发现亚马逊的Trainium 1和Trainium 2芯片性能“逊于”英伟达的H100 GPU.Cohere报告称,Trainium 2 的访问权限“极其有限”,并且经常出现服务中断。

知名AI图像生成初创公司Stability AI也表达了类似的担忧。该公司在一份文件中指出,亚马逊的Trainium 2芯片在延迟方面不如英伟达的H100 GPU,导致其在速度和成本方面“竞争力下降”。

3. 微软

英伟达的一些最大客户已经开始寻求降低对英伟达GPU依赖的方法。出于类似的原因,微软也位列其中。微软的Azure不仅是全球第二大云服务平台,而且还与ChatGPT的开发商OpenAI保持着密切的合作关系。

OpenAI是领先的人工智能开发商,其ChatGPT是最受欢迎的人工智能应用。然而,该公司目前巨额亏损,并且最近因其将如何为其签署的价值1.4万亿美元的人工智能基础设施项目提供资金而面临越来越严格的审查。目前看来,OpenAI随意为GPU开空白支票的日子不会很长了。

微软和OpenAI近期调整了合作关系,将在定制AI芯片领域展开更紧密的合作。OpenAI一直与博通合作设计定制芯片,微软CEO萨蒂亚·纳德拉近期表示,微软将为这些项目提供支持,以实现双方的互利共赢。这无疑是对英伟达的又一次警告,表明其在AI数据中心芯片领域的垄断地位可能很快将面临严峻挑战。

不过,与Alphabet的TPU一样,微软的定制芯片(例如Maia 100 AI加速器和 Cobalt 100 CPU)也存在通用性不如英伟达的问题。这些芯片都是内部设计的,旨在针对微软Azure数据中心内的特定硬件和软件生态系统进行高度优化。

例如Maia 100专为运行微软自家的AI产品和OpenAI模型(例如GPT-3.5 Turbo)而定制,而Cobalt 100 CPU则适用于通用云服务。与使用通用GPU处理所有工作负载相比,这种专业化设计能够针对特定任务实现更高的能效和成本节约,但通用性不佳。

主编精选,篇篇重磅,请点击订阅“邮件订阅”

|

|