AI历史性时刻!美立法机构正式启用人工智能工具,不只拿来打仗

人工智能的发展势不可挡,本周迎来了历史性时刻:美国参议院已经正式启用三款AI工具。

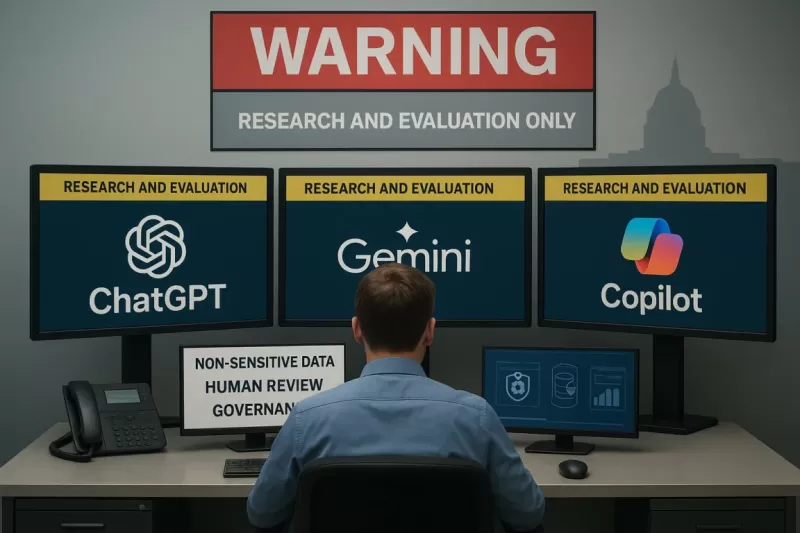

参议院正式使用三款AI聊天工具

据《纽约时报》周二援引一份备忘录报道,ChatGPT和其他两款人工智能聊天机器人已获准在美国参议院正式使用。

报告还指出,助手们可以使用谷歌的Gemini、OpenAI的ChatGPT或微软的Copilot。

周一,一位参议院高级官员批准助手们使用以上三款AI聊天机器人处理公务,这反映出这类产品在全球各地的工作场所已经得到广泛应用。

参议院纠仪长(Sergeant-at-Arms,参议院的执法首长,维持参议院议场的秩序)的安全首席信息官负责监督参议院的计算机和安全,他在一份单页备忘录中表示,他的助手们可以使用谷歌的Gemini、OpenAI的ChatGPT或微软的Copilot,Copilot已经集成到参议院的电脑平台之中。

备忘录称,Copilot“可以帮助处理参议院的日常工作,包括起草和编辑文件、总结信息、准备发言要点和简报材料,以及进行研究和分析”。

该备忘录补充说:“与Copilot Chat共享的数据保留在安全的Microsoft 365政府环境中,并受到与保护其他参议院数据相同的控制措施的保护。”

但目前尚不清楚AI工具在参议院的使用范围会有多广,或者说目前的普及程度如何。参议院办公室和各委员会通常各自独立运作,制定自己的规则供工作人员遵守,而参议院本身尚未公开AI使用规则。

因此,参议院处理敏感或机密信息的工作人员在使用AI工具的时候应遵循哪些规范,成为最值得关注的问题。

据致力于国会现代化的无党派非营利组织POPVOX基金会称,众议院的工作人员已被允许使用Copilot、Gemini和ChatGPT,以及Anthropic的Claude。该基金会表示,他们已经审查了参众两院的内部人工智能指南。

据该基金会报告,根据众议院2024年9月通过的一项政策,人工智能通常可用于不涉及敏感信息、仅供内部使用且不会用于重大决策的事项。但若要将人工智能用于更复杂的用途,例如生成选民来信或为国会议员起草发言稿,则必须获得管理人员的批准。此外,禁止使用人工智能生成深度伪造视频,也禁止在处理选民个案时使用选民的个人信息。

根据POPVOX的审查,参议院的政策还建议用户不要在人工智能工具中输入个人身份信息或物理安全信息。

美军方深度使用AI工具

周三,最新报道显示,谷歌正在向美国战争部超过300万名文职和军事雇员推广Gemini人工智能代理。据战争部负责研究与工程的副部长埃米尔·迈克尔称,这些人工智能代理最初将在非机密网络上运行,目前正在商讨将其扩展到机密和绝密系统。

谷歌副总裁吉姆·凯利表示,八个预置代理将自动执行诸如会议记录摘要、编制预算以及对照国家国防战略检查拟议行动等任务。

自去年12月以来,已有120万战争部员工通过五角大楼的GenAI.mil门户网站使用谷歌的AI聊天机器人处理非机密工作,累计运行了4000万条不同的提示信息,并上传了超过400万份文件。

此外,据《华尔街日报》报道,美国中央司令部在对伊朗的空袭中,就使用了Anthropic公司的Claude人工智能系统进行“情报评估、目标识别和模拟战斗场景”。

但在此空袭之前几小时,美国总统特朗普宣布禁止使用联邦机构Anthropic及其人工智能工具。他在Truth Social网站上谴责Anthropic是“一家激进左翼人工智能公司,其运营人员对真实世界一无所知”。

人工智能早已应用于战争领域,例如分析卫星图像、探测网络威胁和引导导弹防御系统。但如今,聊天机器人——这项被数十亿人用于撰写电子邮件等日常任务的底层技术——也正被应用于战场。

去年11月,Anthropic与数据分析公司Palantir Technologies Inc.合作,该公司为五角大楼做了很多工作,将Anthropic的大型语言模型Claude转化为军方决策支持系统中的推理引擎。

今年1月,Anthropic向五角大楼提交了一份价值1亿美元的提案,旨在开发语音控制的自主无人机集群技术。该公司的方案是:利用Claude将指挥官的意图转化为数字指令,从而协调无人机群的飞行。

美军在1月份突袭抓捕委内瑞拉总统尼古拉斯·马杜罗的行动中就使用了Claude人工智能工具。Anthropic对此表示反对,并指出其使用条款不允许将Claude用于暴力目的、武器研发或监视用途。这引发了特朗普和五角大楼的反感。

在特朗普禁止联邦机构使用Anthropic Claude之后,五角大楼要求Anthropic在六个月内将其人工智能服务移交给其他供应商,并称该公司对美国供应链构成风险。这导致Anthropic于周一起诉战争部。

自从与Anthropic与五角大楼决裂后,竞争对手OpenAI填补了这一空白。OpenAI首席执行官山姆·奥表示,他已与五角大楼达成协议,允许其在机密网络中使用该公司的AI工具,其中包括ChatGPT。

安全性和准确性引发质疑

然而,人工智能工具应用在战争中的安全性和准确性引发普遍质疑。

美国军方采用一个名为“薰衣草”(Lavender)的人工智能驱动数据库,用于识别加沙地带与哈马斯有关的军事目标。它并非大型语言模型,而是分析了海量的监控数据,例如社交关系和位置历史记录,并为每个人分配一个1到100的分数。当某人的分数超过特定阈值时,“薰衣草”就会将其标记为军事目标。

但问题在于,根据以色列-巴勒斯坦媒体+972发布的一份调查报告,“薰衣草”的预测有10%的概率是错误的。牛津互联网研究所数字伦理和国防技术教授 Mariarosaria Taddeo称:“大约有3600人被错误地列为目标。”

“这些系统存在着令人难以置信的脆弱性和极度的不可靠性……而战争却是如此动态、敏感和人性化的事物,”伦敦玛丽女王大学政治理论教授、著有《死亡机器:暴力技术的伦理》一书的埃尔克·施瓦茨说道。

施瓦茨指出,人工智能常被用于战争以加快进程,但这往往会导致意想不到的后果。更快的决策往往是在更大的规模上做出,而且缺乏人为审查。她表示,过去十五年来,人工智能在军事领域的应用变得更加不透明。

主编精选,篇篇重磅,请点击订阅“邮件订阅”

|

|